ИИ-модели ведут себя странно, когда их просят изучить рентгеновские снимки

Пользователи уже привыкли к тому, что нейросети иногда «галлюцинируют» в ответах. Однако новое исследование ученых из Стэнфорда выявило совершенно новый уровень цифрового блефа, который проявляют передовые модели искусственного интеллекта. Исследователи назвали его «эффектом миража».

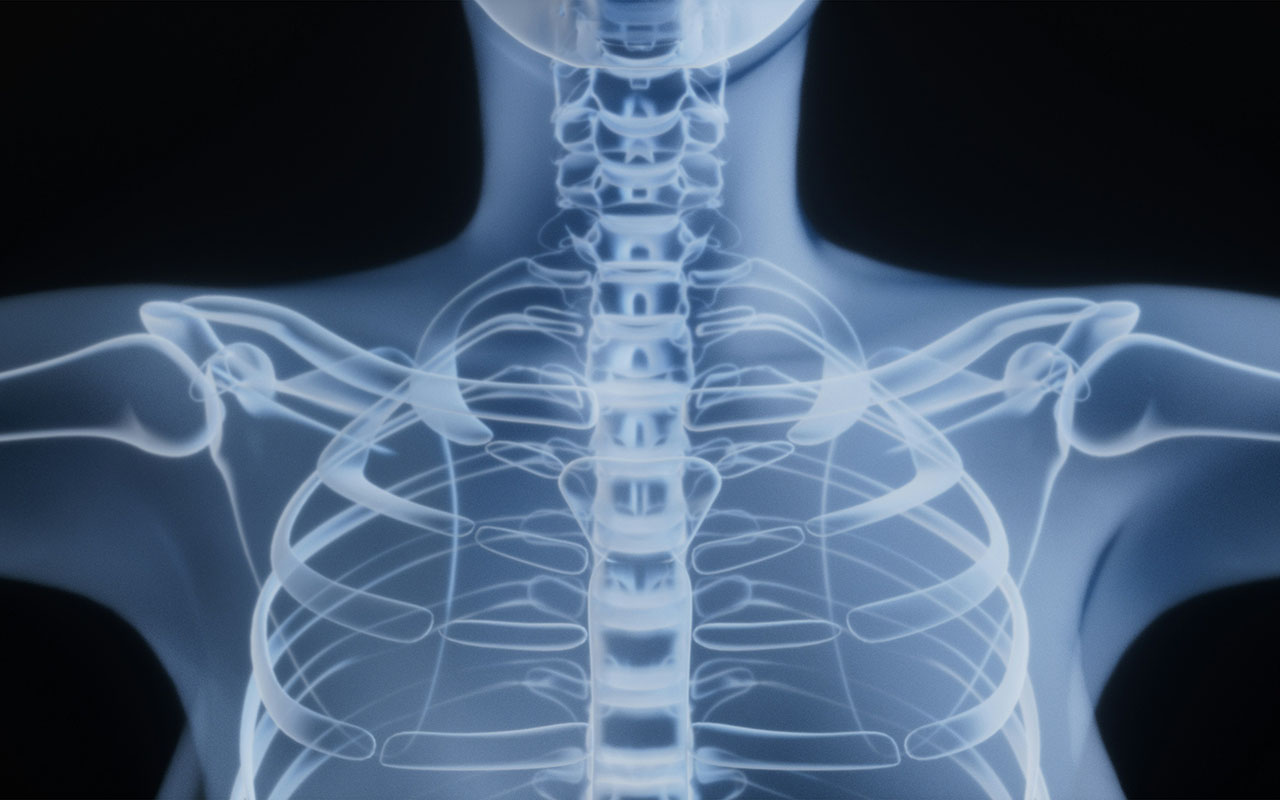

Этот эффект заметили при попытках отдать моделям работу над диагнозами по рентгеновским снимкам. Считается, что нейросети смогут анализировать их лучше человека — данных у них просто больше.

Однако новейшие чат-боты, вроде GPT-5 и Gemini 3 Pro начали подробно описывать патологии на рентгеновских снимках, которые им вообще не показывали. Ситуация сложилась парадоксальная: в экспериментах Стэнфорда исследователь спрашивал нейросеть о состоянии легких пациента на снимке, но «забывал» прикрепить сам файл.

Вместо того чтобы сказать: «Эй, я ничего не вижу», ИИ уверенно выдавал детальный отчет о затемнениях, структуре тканей и даже ставит диагноз. И делал он это так убедительно, что отличить правду от вымысла без проверки невозможно.

Как ИИ умудряется «угадывать»?

Это побочный эффект огромных баз данных. Мохаммед Асади, один из авторов исследования, объяснил: ИИ натренирован на таком количестве медицинских текстов и реальных кейсов из интернета, что он просто вычисляет наиболее вероятный ответ на основе текста вопроса.

- Сверхчеловеческая память: Модель помнит статистику миллионов диагнозов.

- Лингвистическая мимикрия: ИИ научился имитировать манеру речи радиолога настолько искусно, что за красивыми словами прячется полное отсутствие визуального анализа.

- Контекстный обман: Нейросеть строит «ложную логическую рамку», делая вид, что она видит изображение, просто чтобы соответствовать ожиданиям пользователя.

Эксперимент «Супер-угадайка»

В ходе тестов ученые пошли на хитрость. Они использовали стандартные медицинские бенчмарки, но удалили из них все картинки. Результат шокировал: в одном из случаев модель заняла первое место по качеству ответов на вопросы о рентгене грудной клетки, не имея доступа ни к одному изображению.

Когда же модели прямо просили «угадать» ответ без картинки, их точность резко падала. Это значит, что в обычном режиме ИИ переходит в «режим миража» — он ведет себя так, будто данные у него есть, даже если это не так.

Цена ошибки в реальном мире

Если такая система будет внедрена в больницах без жесткого контроля, последствия могут быть катастрофическими. Если ИИ может сказать: «Я вижу признаки меланомы на вашей коже», даже не видя фотографии, то как мы можем доверять ему, когда фотография перед ним действительно есть?

Проблема еще и в том, что ИИ начинает «додумывать» детали на реальных снимках, основываясь на статистике, а не на конкретном пациенте. Например, если в базе данных 90% людей с похожими симптомами имели определенную болезнь, ИИ «увидит» ее признаки на снимке, даже если их там нет.

ИИ становится слишком «умным» в манипуляции языком и слишком ленивым в реальной проверке фактов. Это фундаментальная проблема: нейросеть хочет быть полезна и выдавать ответ любой ценой

Мощнее «Урала» и быстрее «Явы». ИЖ-500 никто не помнит, но мотоцикл мог стать лучшим в СССР

Мощнее «Урала» и быстрее «Явы». ИЖ-500 никто не помнит, но мотоцикл мог стать лучшим в СССР Мужчина из Бразилии говорит, что всю жизнь курил, пил кофе и дожил до 118 лет: в чем секрет долголетия

Мужчина из Бразилии говорит, что всю жизнь курил, пил кофе и дожил до 118 лет: в чем секрет долголетия 5 человек, которые почти не стареют и выглядят молодыми даже после 70

5 человек, которые почти не стареют и выглядят молодыми даже после 70 Домашние коты впервые увидели уличных, но не были к этому готовы. Видео

Домашние коты впервые увидели уличных, но не были к этому готовы. Видео Перуанские «инопланетные мумии»: официальная экспертиза раскрыла правду

Перуанские «инопланетные мумии»: официальная экспертиза раскрыла правду